なぜ今「FLUX.2」が注目されているのか

ここ数年、画像生成AIは「とりあえずきれいな絵が出るだけで感動」という段階から、「ちゃんと仕事で使えるかどうか」が問われる段階に入りました。

そこに登場したのが、ドイツ発のスタートアップ Black Forest Labs(BFL)が送り出した新モデルファミリー「FLUX.2」です。Stable Diffusionの中心メンバーだった研究者たちが立ち上げた会社の最新作ということもあり、登場前からコミュニティの期待値はかなり高めでした。

今回のFLUX.2が面白いのは、「Nano Banana Pro」や「Midjourney」のようなクローズドな超高性能モデルに真っ向から勝負しつつも、オープンコア戦略を維持している点です。Proグレードの商用APIと、ローカルで動かせるオープンウェイトのDevモデル、さらに将来的には完全オープンなKleinまで用意し、「試したい人」「作り込みたい人」「プロダクションで回したい企業」のそれぞれに入り口を用意しています。

もうひとつのポイントは、「デモでバズる画像を1枚出せればOK」という方向ではなく、4メガピクセル級の高解像度で、文字も、レイアウトも、キャラクターの一貫性もきちんと管理できる、いわば「現場で回せる画像生成インフラ」を目指していることです。

プロンプトを投げるたびに結果がバラバラで「今日のAIガチャはハズレでした…」という状況から卒業したい人には、かなり気になるアップデートだと思います。

さらに、BFLはFLUX.2の性能をきちんと数値で示すために、他のオープンウェイトモデルとの比較ベンチマークも公開しています。テキストからの生成、1枚の画像を基準とした編集、複数画像を基準にした編集の3カテゴリで、FLUX.2 Devは他モデルに対して高い勝率を出しており、「体感だけでなく、数字でも強い」ことをアピールしています。

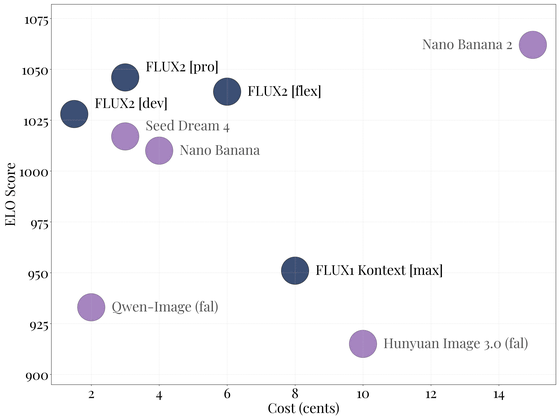

しかも、品質評価(ELOスコア)と1枚あたりのコストを並べて比較すると、FLUX.2 Pro / Flex / Devはいずれも高品質ゾーンにいながら低コスト帯に位置しており、GoogleのNano Banana Proよりかなり安い価格レンジに収まっています。

要するに、FLUX.2は「画質がいい」「賢い」だけでなく、「ちゃんと運用できて、コストも現実的」という三拍子を揃えにきたモデルファミリーです。ここを押さえておくと、この後の各機能や価格の話もスッと入ってきやすくなります。

FLUX.2の頭脳と心臓:VAEとマルチリファレンスが変える画像生成

FLUX.2の特徴はたくさんありますが、その中核にあるのが新しいVAE(Variational Autoencoder)とマルチリファレンス機能です。少しだけ技術寄りの話になりますが、ここが分かると「なぜFLUX.2は現場向きと言われるのか」が腑に落ちます。

VAEはざっくり言うと、「画像を一度ギュッと圧縮して、あとからきれいに戻すための変換装置」です。FLUX.2では、このVAEをApache 2.0ライセンスで完全オープンにしており、全バリエーション(Pro・Flex・Dev・Klein)が同じ潜在空間(latent space)を共有する設計になっています。

これにより、企業や開発者は自社内のパイプラインでこのVAEを共通基盤として採用しつつ、必要に応じてBFLの商用APIと行き来できる、という柔軟な構成が可能になります。ベンダーロックインを避けながら、高品質な潜在空間だけを「標準部品」として使えるイメージです。

実務的に効いてくるのが、再構成品質と圧縮率のバランスです。潜在ベースの画像生成では、「圧縮しすぎると元画像がボロボロになる」「圧縮が甘いとモデルの学習や推論が重くなる」というジレンマが常につきまといます。FLUX.2のVAEは、過去世代より低い歪み(LPIPS)と良い生成品質(FID)を両立したとされており、4メガピクセルの高解像度編集でも破綻しにくいのが売りになっています。

もうひとつの目玉がマルチリファレンス(最大10枚)です。これは、たとえば以下のようなシーンで真価を発揮します。

- ECサイトの商品写真:同じ靴を、角度や背景を変えても「同じ靴」に見せたい

- キャラクターデザイン:あるキャラを、別ポーズ・別シーンでも同一人物として維持したい

- ブランドクリエイティブ:ブランドカラーやロゴ、トーンを崩さずにバリエーションを増やしたい

従来のモデルだと、「似てるけど別人」問題が頻発し、「もうこの子は誰なんだ…?」という結果になりがちでした。FLUX.2は複数の参照画像からアイデンティティやスタイルを抽出し、それを保ったまま構図やシーンだけを変えることが得意です。

実際の現場では、デザインチームが「ブランドブック」「過去の広告」「モデル写真」などをまとめて参照として渡し、そこから一気にキャンペーン用のバリエーションを生成するといった使い方が想像できます。

さらに、FLUX.2はテキストレンダリングも強化されています。高解像度のまま、UIモックやインフォグラフィック、ポスターの見出しなどを「読める文字」として描けるようになったため、「あとでPhotoshopで全部打ち直す前提」のワークフローから徐々に卒業しやすくなります。

「画像は完璧なのに、文字だけ異世界言語」というあるあるから解放されるのは、多くのデザイナーにとってかなりありがたいポイントではないでしょうか。

4つのモデルと料金イメージ:Pro・Flex・Dev・Kleinの使い分け

FLUX.2は単一モデルではなく、用途に合わせた5つのコンポーネントで構成されています(VAEを含めると5つ)。なかでもよく名前が挙がるのが、Pro・Flex・Dev・Kleinの4兄弟です。それぞれの性格をざっくり整理してみます。

- FLUX.2 [Pro]:最高性能・最低レイテンシを狙った商用向けフラッグシップ。BFLのPlaygroundやAPI、提携プラットフォーム経由で利用可能。

- FLUX.2 [Flex]:サンプリングステップ数やガイダンススケールを細かく調整できる、チューニング好きの開発者向けモデル。

- FLUX.2 [Dev]:32Bパラメータのオープンウェイトモデル。テキスト生成と画像編集を一体化し、ローカル実行にも対応。

- FLUX.2 [Klein]:近日登場予定の軽量モデル。Apache 2.0ライセンスの完全オープンソースとしてリリース予定。

料金面でインパクトがあるのはProです。FLUX.2 Proは1メガピクセルあたり約0.03ドルというシンプルな課金体系で、1024×1024(ちょうど1MP)の画像生成は1枚0.03ドル程度、解像度が上がればほぼ比例して伸びます。マルチリファレンスを使うと、入力画像もメガピクセルとしてカウントされるため、ガッツリ使うワークフローではその点の設計が重要になります。

一方、GoogleのGemini 3 Pro Image Preview(通称 Nano Banana Pro)はトークン課金モデルで、1K〜2K解像度の画像あたり実質0.134ドル前後、4Kクラスで0.24ドル程度とされています。ざっくり比べると、同程度の解像度でFLUX.2 ProはNano Banana Proの約1/4〜1/8のコストに収まる計算です。

もちろん、モデルの性格やエコシステムは違うので単純比較はできませんが、「高解像度画像を大量に回す」ような現場では、この差はかなり効いてきます。

Devモデルは、BFLの参照実装やNVIDIA・ComfyUIと連携したfp8最適化のおかげで、32Bという巨大モデルでありながら、ハイエンドRTXクラスのGPUでローカル実行も視野に入ります。

「クラウドAPIでまずはPoC → コストやレイテンシを見ながら、一部をDevモデルのローカル推論に切り替える」といったハイブリッド構成も組みやすく、インフラ寄りのエンジニアにとっては設計の自由度がかなり高いファミリーと言えます。

KleinがApache 2.0で出てくれば、「まずは軽量モデルを完全に自社インフラで回しつつ、必要に応じてPro/Flexにスケールアウト」という構成も現実的になります。

個人クリエイター向けには、Playgroundや提携サービス経由でPro/Flexに触りつつ、技術寄りのユーザーはDev/Kleinをローカルでいじる、という二段構えの世界が見えてきます。

クリエイターと企業ワークフローをどう変えるのか

では、FLUX.2が現場のワークフローに入ってくると、何がどのように変わるのでしょうか。ここでは、クリエイティブ職とビジネス側の両方の視点からイメージしてみます。

まずクリエイター視点で大きいのは、「一貫性」と「文字」の2つのストレス源がかなり軽減されることです。

マルチリファレンスによって同じキャラクターや同じ商品を様々なシーンで維持しやすくなり、「このショットだけ微妙に顔が違う」「ロゴの形が崩れている」といった修正ループが減ります。テキストレンダリングが強化されたことで、ポスターやバナーの初稿段階から「だいたいこのまま使えそう」というレベルのものが出てくるケースも増えるでしょう。

たとえば、あるECチームをイメージしてみます。これまでは、商品ごとにスタジオ撮影 → レタッチ → 各デバイス用のトリミング、といった手順を踏んでいたとします。FLUX.2を導入すると、代表的なマスタ写真とブランドスタイルを参照画像として登録し、

「背景を季節ごとに変えたバリエーション」

「SNS用の縦長構図」

「バナー用の横長+テキスト入り」

といったパターンを半自動で量産する、といった運用が可能になります。

制作会社やインハウスのデザインチームでは、ラフ〜コンセプト段階のスピードアップも期待できます。ストーリーボードや世界観の方向性を固めたいときに、FLUX.2に複数のリファレンスを渡して「この世界観で、こういうカットを10枚」と投げるだけで、打ち合わせ用の素材が一気に揃うイメージです。完成品品質をいきなり目指すというより、構図・色・トーンの方向性を素早く合意形成するためのツールとして機能しやすくなります。

ビジネス側の視点では、FLUX.2の高解像度対応とコスト効率が効いてきます。マーケティング部門が大量のA/Bテスト用クリエイティブを回したり、SaaSやゲームのUIモックを高速に生成したりする場面で、「1枚あたりのコスト」と「自動化のしやすさ」はかなり重要です。

JSON的な構造化プロンプトやAPI連携を活用すれば、「ユーザー属性に応じたバナーを自動生成」「商品データベースから自動でLP用画像を生成」といった、よりプログラマティックな活用も視野に入ります。

もちろん、万能ではありません。完全に人間のアートディレクションを代替するというより、「下絵生成」「バリエーション展開」「一貫性の維持」といった部分をFLUX.2に任せ、最後の詰めや意思決定は人が行う、という役割分担が現実的です。

しかし、そこをうまく設計できれば、「クオリティを落とさずに制作量だけを3倍にする」といった現場ならではの野望にも、かなり現実味が出てくるはずです。

エンタープライズ視点で見るFLUX.2:ロックイン回避とガバナンス

企業の技術責任者やアーキテクトにとって、モデル個々の性能以上に気になるのが「運用」「統合」「ガバナンス」です。FLUX.2はこのあたりもかなり意識して設計されています。

まず、ホスト型エンドポイント(Pro/Flex)とオープンウェイト(Dev)を両方提供している点が大きな特徴です。

・PoCや負荷変動の大きい本番環境にはPro/FlexのAPIを使う

・安定したワークロードや機密度の高い処理はDevを自社インフラでホスティングする

といった住み分けがしやすくなります。CI/CDに組み込んだり、既存のMLOps基盤に載せたりすることも、オープンウェイトであれば比較的スムーズです。

また、潜在空間を提供するVAEがApache 2.0でオープンというのも、エンタープライズにとっては重要なポイントです。

社内で独自に訓練した画像生成モデルや、他社モデルと組み合わせるときでも、「潜在表現の形式だけは揃える」という設計が可能になります。将来、新しいモデルを導入したくなったときも、同じ潜在空間に対応しているモデルであれば、下流のワークフローを大きく変えずに差し替えができます。

セキュリティとコンプライアンスの観点では、ホスト型とセルフホスト型で求められるガバナンスが変わる点も押さえておきたいところです。

ホスト型エンドポイントを使う場合、アクセス制御や利用ログ、レートリミットなどは提供事業者側の仕組みにかなり依存します。その代わり、モデルウェイトの保護やアップデート管理は任せられるため、「内部でモデルファイルを持ちたくない」という組織には向いています。

一方、Devモデルのようなオープンウェイトを自社で運用する場合、

・モデルのバージョン管理

・モデル改変の禁止ルール

・推論時ログの保持とモニタリング

・生成結果に対するポリシー(NGコンテンツ)の定義と検知

といったルール作りが欠かせません。FLUX.2はテキストや構図をかなりリアルに表現できる分、不適切な用途への利用をどう防ぐかという「利用側の覚悟」も求められます。

とはいえ、BFL自身もFLUX.1の頃から利用ポリシーやガイドラインを積極的に公開しており、「性能だけ高いブラックボックス」というスタンスではありません。オープンコアを維持しつつ、研究者・開発者・企業の三者がそれぞれの立場で参加できるエコシステムを志向している点は、他のクローズドモデル陣営と比較したときの大きな違いと言えるでしょう。

これから画像生成AIを始める人へのロードマップ

最後に、「これから画像生成AIをちゃんと触ってみたい」「Stable Diffusionは軽く触ったけれど、次の一手を考えたい」という方に向けて、FLUX.2時代の歩き方を簡単に整理してみます。

まず、とりあえず試してみたい段階であれば、BFLや提携サービスが提供するPlaygroundやホスト型APIから入るのがおすすめです。キャラクター生成、商品モック、UI案、ロゴ入りの簡単なバナーなど、日常的に使いそうなユースケースで「どのくらい一貫性が出せるか」「文字はどの程度読めるか」を確かめてみると、他モデルとの違いが見えやすくなります。

次に、ワークフローに組み込みたい段階では、JSON的な構造化プロンプトや、既存システムとの連携方法を検討します。たとえば、

- 商品マスタやユーザーデータベースと連携したバナー自動生成

- デザインツール(Figmaなど)と連携した下絵生成

- 社内ポータルから簡易プロンプトで画像生成できるフロントエンドの構築

といった方向性が考えられます。この段階からは、Pro/FlexのAPIを使いつつ、一部のユースケースでDevモデルのローカル実行を検証してみるのもよいでしょう。

そして、本格的に自社インフラとして据えたい段階では、VAEを中心とした潜在空間の標準化と、モデルガバナンスのルール作りがカギになります。

・どの案件でどのモデルを使うのか

・生成物の保管・再利用ポリシーをどうするか

・プロンプトや生成結果をどこまでログとして残すか

といった設計は、早めに考えておくほど後が楽になります。FLUX.2のようにオープンウェイトと商用APIが両方あるモデルは、この「段階的な採用ロードマップ」を描きやすいのが大きな利点です。

画像生成AIの世界は、Nano Banana ProやMidjourneyといった強力なプレイヤーがひしめき合う、なかなかの激戦区です。その中でFLUX.2は、「高品質」と「コスト」と「オープン性」のバランスを取りにきた、かなり実務寄りの選択肢と言えます。

遊び感覚で触るのももちろん楽しいですが、「せっかくなら自分や自社のワークフローを一段ステップアップさせる道具として活用する」という視点で触ってみると、FLUX.2の設計思想がよりクリアに見えてくるはずです。