サイバー攻防戦の歴史といま直面する現実

サイバーセキュリティは50年以上にわたって進化を続けてきましたが、その成果は決して安心できるものではありません。実際、アジア太平洋地域の69%の企業は、自社の情報漏えいを外部からの通知によって初めて知ったというデータがあります。つまり、多くの組織は攻撃を「受けたことすら気づけない」状態にあるのです。

これは驚くほど古い課題でもあります。1972年にセキュリティの先駆者ジェームズ・P・アンダーソンが「システムは自分自身を守らない」と指摘して以来、基本的な脆弱性は今日まで残り続けています。設定ミスやパスワード流出といった“初歩的な落とし穴”が、依然として侵入の入り口になっているのです。まるで玄関の鍵を閉め忘れているのに、最新鋭の警報システムを設置しているようなものですね。

AIがもたらす「攻め」と「守り」の両刃の剣

AIはセキュリティ分野における救世主のように語られることがあります。膨大なログデータを解析して異常を素早く見つける、攻撃パターンを学習して将来のリスクを予測する、といった能力は確かに人間を大きく助けてくれます。

しかし忘れてはいけないのが、攻撃者も同じAIを使えるという事実です。生成AIによって巧妙なフィッシングメールを大量に作り出すことも、ゼロデイ脆弱性を探し出すことも、これまで以上に容易になっています。

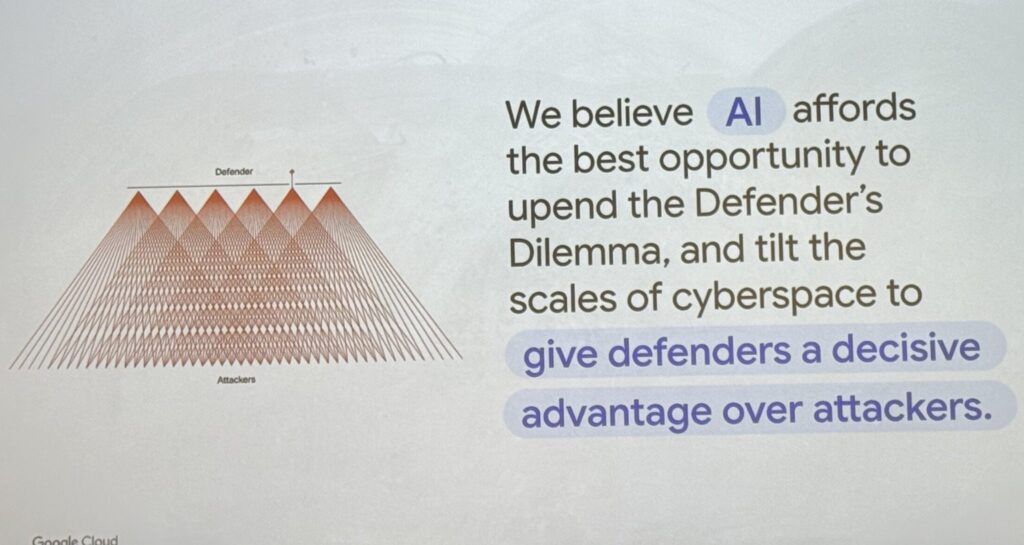

これは「守る側が常に全てを成功させなければならないのに、攻撃者は一度の成功で目的を達成できる」という非対称な戦いをさらに過酷にしています。Google Cloudはこのジレンマを「Defender’s Dilemma(防御者のジレンマ)」と呼び、AIを活用してその不利を覆そうとしています。

AIによる脆弱性発見:Project Zeroの「Big Sleep」

AIが実際に成果をあげている事例のひとつが、Googleのセキュリティチーム「Project Zero」が進める「Big Sleep」です。このプロジェクトでは、大規模言語モデルを使ってコードの脆弱性を自動的に洗い出します。

例えばオープンソースのライブラリからAIが新しい脆弱性を発見した事例が報告されました。人間が手作業で何週間もかける仕事を、AIは短時間でやり遂げるのです。しかもその数はどんどん増え、ある月には47件もの脆弱性を見つけたといいます。

この流れは、セキュリティ業務が「人の目と経験」に依存していた時代から、「AIが先に見つけ、人間が検証する」という新しいパラダイムへ移行していることを示しています。AIが虫眼鏡を持ち、専門家が最後の判定を下す――そんな協働体制が現実味を帯びてきました。

自動化の甘い罠:AIに任せすぎてはいけない理由

自動化が進むと「じゃあ全部AIに任せればいいのでは?」と思いたくなります。しかし、そこには落とし穴もあります。AIが判断を誤ったり、外部から操作されて不正な結果を出すリスクがあるからです。

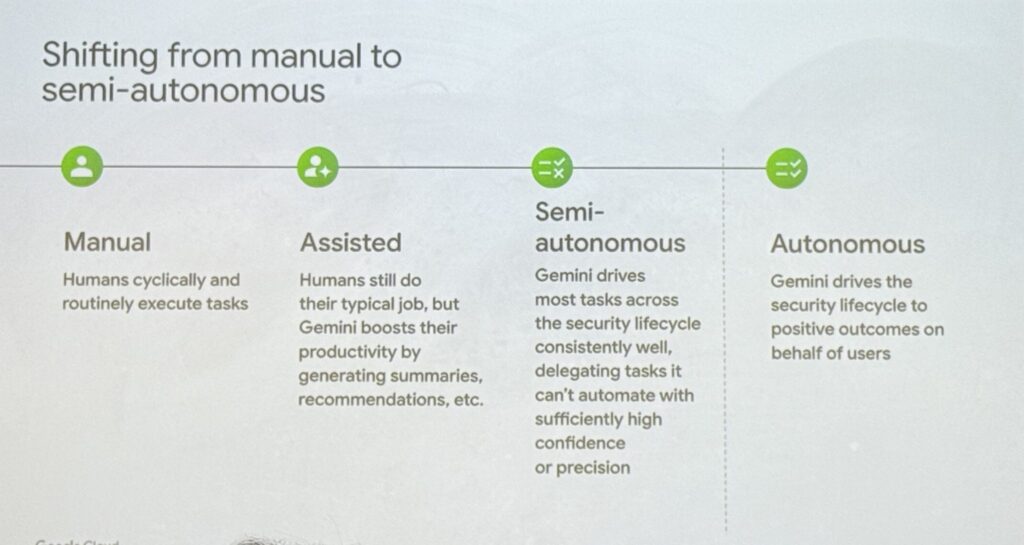

Google Cloud自身も「完全自動化」ではなく「人間とAIの協働」を重視しています。AIが大量のノイズを処理し、人間は最終的な判断や予測不能な事態への対応に集中する。これはまるで飛行機の自動操縦に似ています。通常のフライトはAIが担っても、嵐や緊急事態では人間のパイロットが必要不可欠なのです。

つまり、AIは万能ではなく「頼れる副操縦士」。企業にとって重要なのは「どこまでをAIに任せ、どこからを人間が担うか」という線引きを明確にすることです。

ビジネス現場での実装課題:予測不能なAIと「影のAI」

理論的に素晴らしいAIも、現場で使うとなると意外な難題が出てきます。そのひとつが「文脈のズレ」です。小売店のカスタマーサポートAIが、突然医療アドバイスを始めてしまったらどうでしょう?ユーザーは混乱し、ブランドの信用を失うリスクもあります。

そこでGoogleは「Model Armor」という仕組みを導入しています。これはAIの回答をチェックし、企業にそぐわない内容や個人情報の漏洩を防ぐフィルター機能です。ちょうど「言いすぎ防止フィルター」のようなものですね。

さらに厄介なのが「影のAI(Shadow AI)」です。社員が勝手に外部のAIツールを使ってしまい、セキュリティ上の抜け穴を作ってしまうケースが急増しています。こうした“野良AI”を監視し、検知することも今やセキュリティ対策の重要な柱となっています。

予算の制約と未来への準備

アジア太平洋地域のCISO(最高情報セキュリティ責任者)たちが抱える最大の悩みは、予算不足だと言われています。攻撃の数は増えているのに、セキュリティチームを増員する余裕はない。結局「少ない人数で大量の攻撃に対応する」消耗戦になってしまうのです。

Google Cloudのようなクラウドサービスにパートナーシップを求める企業が増えているのは、この“リソース不足”を解決するためでもあります。そしてもうひとつ見逃せないのが、量子コンピュータ時代に備えた暗号技術です。Googleはすでにデータセンター間の通信で「ポスト量子暗号」を導入し、未来の脅威に先手を打っています。

つまり戦いは「今ここ」で終わるのではなく、数十年先の安全性を見据えて続いていくのです。

まとめ:AIセキュリティ時代を生き抜くために

AIはサイバーセキュリティの強力な武器となり得ますが、同時に新しいリスクも連れてきます。Google Cloudの取り組みは、その両面を認めたうえで「AIと人間の協働」に未来を託すアプローチだと言えるでしょう。

結局のところ、最も重要なのは「基本を守ること」。設定ミスやパスワード管理といった古くからの課題を放置したままでは、どんなに高度なAIを導入しても土台が崩れてしまいます。

サイバー攻防の勝敗を分けるのは、最新技術そのものよりも、それを「どう実装し、人間がどう活用するか」です。AIセキュリティの戦いは始まったばかりですが、慎重さと遊び心を忘れずに取り組めば、未来は決して暗くないはずです。